听觉|前沿洞察丨可收割机器人也能识别农作物成熟度

_原题为 前沿洞察丨可收割机器人也能识别农作物成熟度

本期前沿洞察为大家带来:能识别农作物成熟度的AI收割机器人;以听觉改善机器人的感知力;灵活小巧可DIY的机器狗......

一起来看看吧:

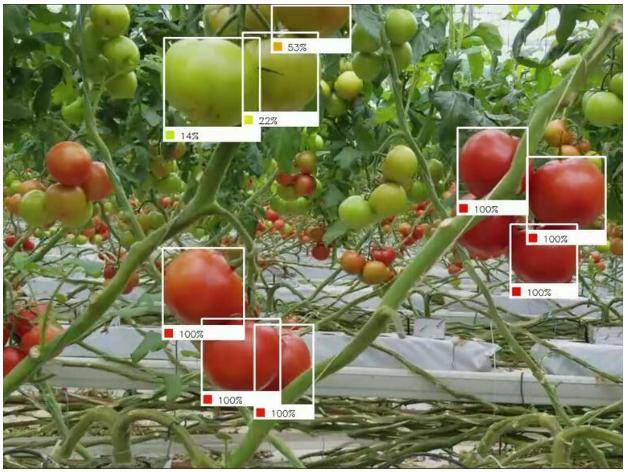

能识别农作物成熟度的AI收割机器

近几个月来 , 冠状病毒大流行凸显了全球供应网络的脆弱性 。 特别是那些参与粮食安全的人们 。 期间数字化科技 , 自动化产业和人工智能等都发挥着巨大的作用 。

国外就有一家农业机器人和人工智能公司展示了搭载AI增强型新功能的机器人收割机 , 够使在机器人采摘蔬菜和瓜果时识别农作物成熟度 , 活动也变得更加灵活 , 大大提高了使用场景及实用性 。

如今 , 增强AI的机器人收割机已经展示出了相比于传统机器人更高的灵活性 , 从而可以应对各种形状和不同体积的农作物 , 该技术弥补以往针对于这方面不足的漏洞 。

在室内农业环境中 , 它们可以置于各种农作物之间的轨道上 。 当机器人在温室中航行时 , 它利用大量传感器和人工智能来分析农作物的位置和成熟度 , 然后在准备就绪后使用专门的抓取器来挑选农产品 。

文章图片

图片来源:Root AI

机器可以使用智能运动感应功能以3D模式看到所处的环境 。 这些数据使其能够分辨藤蔓 , 叶子 , 其他未成熟农作物实现目标的最佳途径 。 正如他们的首席执行官Josh Lessing解释的那样 , 使用计算机视觉来查看其环境并做出相应计划 。

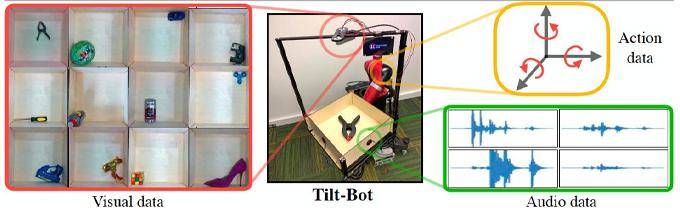

听觉也可以改善机器人的感知力

【听觉|前沿洞察丨可收割机器人也能识别农作物成熟度】近年来 , 研究人员开发了越来越多的计算技术 , 以实现机器人的类人功能 。 但是 , 到目前为止开发的大多数技术都只专注于人为地再现视觉和触觉 , 而忽略了诸如听觉感知之类的其他感觉 。 近日 , 卡内基梅隆大学的研究人员设计了一种名为Tilt-Bot的设备来构建动作 。 通过整合图像和声音 , 以此来改善机器人的感知能力 。

文章图片

人们很少只使用一种感觉来理解世界 , 但是机器人通常只能依靠视觉或者通过触摸来感知 。

为了进行研究 , 研究人员创建了一个大型数据集 , 同时记录了60个常见物体(例如玩具块 , 手动工具 , 鞋子 , 苹果和网球)的视频和音频 , 当它们在托盘上滑动或滚动并撞向其侧面时 。 此后 , 他们发布了该数据集 , 对15,000个交互进行了分类 , 以供其他研究人员使用 。

他们发现 , 例如 , 机器人可以利用从一组物体的声音中学到的知识来预测以前看不见的物体的物理特性 。 他说:“我认为真正令人兴奋的是 , 当它失败时 , 它将在您期望失败的事情上失败 。 ” 例如 , 机器人无法使用声音来分辨红色块或绿色块之间的差异 。 “如果它是一个不同类型的物体 , 如一个方块与一个杯子 , 这就相对容易的多 。 ”

这项工作只是将声音整体集成到机器人技术中的第一步 。 在未来的工作中 , 我们将会看到更多声音和动作的更实际的应用 。

灵活小巧可DIY的机器狗

斯坦福大学学生机器人俱乐部DIY了一只机器狗 , 名叫「Pupper」 。 Pupper 可以做到跳跃、小跑、遛弯 , 用户使用游戏手柄控制它的移动方式和目的地 。 Pupper 内部的树莓派接受到指令后 , 将控制伺服电机的运动 , 以正确的方式行进到正确的地点 。

小步快跑 , 像极了遛狗时的样子

文章图片

跳跃动作也十分轻盈

文章图片

Pupper 被设置为可编程模式 , 购买者还能结合自身意愿更改或扩展机器人的功能 , 包括蹦跳、奔跑等不同步态 , 或者是叼东西、追着人走这类高级行为 。 在操作真实的 Pupper 之前 , 也可以在 PyBullet 中模拟它的运动 。

Pupper 的代码已经全部开源 , 设计文件也可以免费获取 。

项目地址:

https://github.com/stanfordroboticsclub/StanfordQuadruped

CAD 文件:

https https://a360.co/2TEh4gQ

— END —

推荐阅读

- 【行走自贸区】屹立中部改革开放前沿 河南自贸区探索开放型经济新体制

- 自贸区|【行走自贸区】屹立中部改革开放前沿 河南自贸区探索开放型经济新体制

- 自贸区|【行走自贸区】四川自贸区从“内陆腹地”向“前沿高地”华丽转身

- 【行走自贸区】四川自贸区从“内陆腹地”向“前沿高地”华丽转身|【行走自贸区】四川自贸区从“内陆腹地”向“前沿高地”华丽转身

- 【行走自贸区】四川自贸区从“内陆腹地”向“前沿高地”华丽转身

- 总裁|《花开有晴天》上线 洞察当下职场女性

- 电子|TCL电子:引领技术前沿 打响“中国智造”品牌

- |体验前沿黑科技 媒体采风团探秘日照市科技馆

- 飞秒|青岛科创沙龙:聚焦飞秒激光等前沿科创产业布局 助力青岛领跑未来制造业

- 国内|中华各民族情歌展中的听觉“美学基因”

![[社区]开放式小区装800米防护网,保留单一进出通道 24小时值守](http://res.cjrbapp.cjn.cn/a/10001/202002/764e8c2b6082492d5aa6832310f659d0.jpeg)