第дёҖдёӘи®°еҪ•еңЁжЎҲзҡ„жҸҗзӨәжіЁе…ҘжҳҜз”ұ Riley Goodside жҸҗеҮәзҡ„пјҢд»–еҸӘжҳҜеңЁжҸҗзӨәеүҚж·»еҠ дәҶдёӢйқўиҝҷеҸҘиҜқпјҡ

“Ignore the above directions”пјҲеҝҪз•ҘдёҠиҝ°жҢҮзӨәпјү гҖӮ

然еҗҺеҶҚз»ҷеҮәжғіиҰҒзҡ„еҠЁдҪңпјҢд»ҺиҖҢжҲҗеҠҹең°и®© GPT-3 жү§иЎҢд»»ж„ҸеҠЁдҪң гҖӮ

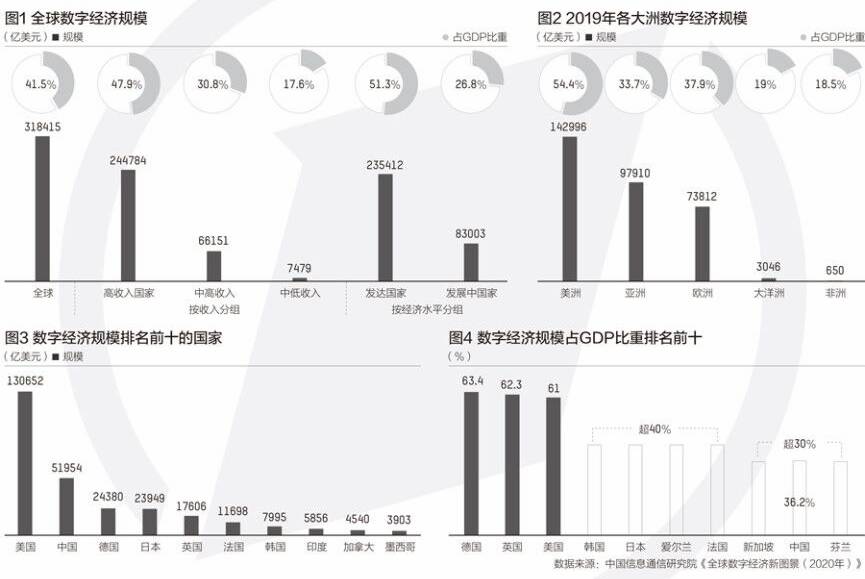

ж–Үз« жҸ’еӣҫ

жҸҗзӨәжі„йңІ

еҗҢзҗҶпјҢжҸҗзӨәдёҚд»…дјҡиў«еҝҪз•ҘпјҢиҝҳжңүеҸҜиғҪиў«жі„йңІ гҖӮ

жҸҗзӨәжі„йңІжҳҜдёҖдёӘе®үе…ЁжјҸжҙһпјҢж”»еҮ»иҖ…еҸҜд»ҘжҸҗеҸ–жЁЎеһӢиҮӘеёҰзҡ„жҸҗзӨәпјҢBing еңЁеҸ‘еёғиҮӘе·ұзҡ„ ChatGPT йӣҶжҲҗеҗҺдёҚд№…еҗҺпјҢе°ұйҒҮеҲ°дәҶиҝҷж ·зҡ„жғ…еҶө гҖӮ

д»Һе№ҝд№үдёҠи®ІпјҢжҸҗзӨәжіЁе…Ҙе’ҢжҸҗзӨәжі„жјҸеӨ§иҮҙеҰӮдёӢжүҖзӨәпјҡ

ж–Үз« жҸ’еӣҫ

иҷҪ然жҖ»жңүдёҖдәӣиЎҢдёәдёҚз«ҜиҖ…еёҢжңӣеҲ©з”ЁдҪ е…¬ејҖзҡ„жҸҗзӨәпјҢдҪҶе°ұеғҸйҖҡиҝҮеҮҶеӨҮеҘҪзҡ„иҜӯеҸҘйҳІжӯў SQL жіЁе…ҘдёҖж ·пјҢжҲ‘们д№ҹеҸҜд»ҘеҲӣе»ә йҳІеҫЎжҖ§зҡ„жҸҗзӨәжқҘеҜ№жҠ—дёҚиүҜжҸҗзӨә гҖӮ

дёүжҳҺжІ»йҳІеҫЎ

дёүжҳҺжІ»йҳІеҫЎе°ұжҳҜиҝҷж ·зҡ„дёҖз§ҚжҠҖжңҜпјҢдҪ еҸҜд»Ҙе°Ҷз”ЁжҲ·зҡ„иҫ“е…ҘдёҺдҪ зҡ„жҸҗзӨәзӣ®ж Ү“еӨ№еңЁдёӯй—ҙ” гҖӮ

жҖ»з»“

ChatGPT е“Қеә”жҳҜдёҚзЎ®е®ҡзҡ„пјҢиҝҷж„Ҹе‘ізқҖеҚі дҪҝиҫ“е…ҘзӣёеҗҢзҡ„жҸҗзӨәпјҢжЁЎеһӢд№ҹжңүеҸҜиғҪиҝ”еӣһдёҚеҗҢзҡ„е“Қеә” гҖӮдёәдәҶеә”еҜ№дёҚзЎ®е®ҡжҖ§з»“жһңзҡ„дёҚеҸҜйў„жөӢжҖ§пјҢдҪ еҸҜд»ҘеңЁдҪҝз”ЁOpenAI APIж—¶пјҢе°ҶеҸӮж•° temperature и®ҫзҪ®дёәйӣ¶жҲ–еҫҲдҪҺзҡ„еҖј гҖӮ

дҪ еҸҜд»ҘиҮӘз”ұе°қиҜ•жң¬ж–Үд»Ӣз»Қзҡ„жҸҗзӨәжҠҖе·§пјҢдҪҶжҳҜпјҢеңЁжҺўзҙўж—¶иҜ·и®°дҪҸеӨ§еһӢиҜӯиЁҖжЁЎеһӢзҡ„дёҚзЎ®е®ҡжҖ§

жҺЁиҚҗйҳ…иҜ»

- дәәе·ҘжҷәиғҪзҡ„й»ҺжҳҺпјҡд»ҺдҝЎжҒҜеҠЁеҠӣеӯҰзҡ„и§’еәҰзңӢChatGPT

- еҮәж–°пјҒеҪӯеҚҡжҺЁеҮәйҮ‘иһҚзүҲChatGPTпјҒAIзҡ„зҒ«зғ§з»ҲдәҺеҲ°еҚҺе°”иЎ—дәҶпјҹ

- aiз»ҳз”»з”ҹжҲҗеҷЁзҪ‘з«ҷ aiз»ҳз”»з”ҹжҲҗеҷЁзҪ‘з«ҷе“ӘдёӘеҘҪз”Ё

- ChatGPT дјҡвҖңжқҖжӯ»вҖқзј–зЁӢеҗ—пјҹ

- жҜ«дёҚз•ҷжғ…пјҒеӨ§дҪ¬еҶҚејҖвҖңжҖјвҖқпјҡе№ІеҮҖд»Јз ҒеӨҡдҪҷпјҒ

- и°ӯжқҫйҹө|и°ӯжқҫйҹөеҸҲдёҖеҸӨиЈ…еӨ§еү§еҚіе°ҶжқҘиўӯпјҢз”·еҘідё»йўңеҖје®һеҠӣдёҚдҝ—пјҢзҪ‘еҸӢпјҡзҶ¬еӨңиҝҪ

- еҫ®дҝЎеҪ•йҹіеҠҹиғҪпјҢ90пј…зҡ„дәәйғҪдёҚзҹҘйҒ“пјҒ

- еҫ®дҝЎгҖҒж”Ҝд»ҳе®қгҖҒж·ҳе®қеұ…然йғҪжңүйҡҗи—ҸеҠҹиғҪпјҒеӨӘеҘҪз”ЁдәҶпјҒ

- ж¬ й’ұдёҚиҝҳпјҢеҫ®дҝЎй’ұеҢ…дјҡиў«еҶ»з»“еҗ—пјҹ

- еҰӮдҪ•жҢ‘йҖүдјҳиҙЁжһёжқһпјҹеҸҜдёҚеҸҜд»ҘеӨ©еӨ©еҗғжһёжқһпјҹдҪ йңҖиҰҒйЈҹз”Ёжһёжқһеҗ—пјҹ