|?深度学习先驱Yann LeCun被骂退推特:你们都很懂,从此我不说话了( 二 )

之后 , Yann LeCun 又在多条推文来解释自己关于偏见的立场 , 但仿佛已经没有用了 。

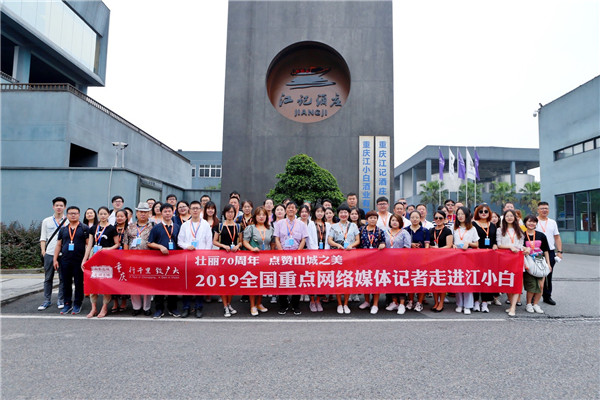

本文插图

「与学术论文相比 , 这种偏见在已经部署的产品中产生的后果会更加可怕 。 」这句话的含义被解读为「不必为此特例而过分担心」 , 引发了诸多同行的质疑 。

斯坦福 AI Lab 成员、Google AI 科学家 Timnit Gebru(她是一名非洲裔美国人) , 对 LeCun 的言论表示「失望」 。

Yann LeCun 甚至在 Timnit Gebru 的推特评论区连写 17 条回复:

本文插图

当然 , 需要讨论的也不只是机器学习中的偏见问题:

本文插图

「同样需要避免的是在对话中产生恶意 , 它只会激起情绪 , 伤害到所有人 , 掩盖实际问题 , 推迟解决方案的出现 。 」

本文插图

从事数据科学领域超过十年的 Luca Massaron 认为 , 尽管从技术角度来看 Yann LeCun 是完全正确的 , 但看看这种观点被抛出之后公众的反应 , 你就会知道谈论它是多么的敏感 。

「人们总是害怕自己会被不公平的规则控制 , 进而无条件地 , 有时甚至毫无理由地惧怕 AI 剥夺人们的自由 , 而不仅仅是工作 , 」Luca Massaron 说道 。 「我个人并不担心 Face Depixelizer 这类研究 , 我所害怕的是在应用之后 , 我们无法识别和挑战偏见 。 」

本文插图

如今 , 越来越多的机器学习自动化技术正在进入我们的生活 , 立法者在这里扮演的角色非常重要 。 在欧盟国家 , 为了确保数据使用的透明度和责任 , GDPR 条例要求互联网公司保证算法的可解释性 , 以及用户对于自身数据的控制力 。

如果我们希望 AI 能够朝着正确的方向发展 , 我们需要追求的或许不是无偏见 , 而是透明度 。 Luca 认为 , 如果算法是有偏见的 , 我们可以挑战它的推断结果并解决问题 。 但如果算法的推理机制不可知 , 或许其中还隐藏着更大的问题 。

本文插图

不可否认的是 , 人类社会存在着各种偏见 , 但因此而认为机器倾向于更「流行」的答案是理所应当的 , 或许不是一个正确的观点 。

本文插图

人们对于 PULSE 的讨论 , 以及 LeCun 的攻击 , 有很多已脱离了 LeCun 的本意 。

作为这场争议的起因 , 杜克大学的研究者们已在 PULSE 网站中表示将会修正有关偏见的问题 。 目前论文中已经增加了一个新的部分 , 并附加了可以解决偏差的模型卡 。

为了达成没有偏见的目标 , 我们必须让整个人工智能社区行动起来 。 但在有关技术的讨论之中让技术大牛心灰意冷 , 是大多数人都不想看到的结果 。 Yann LeCun 此前一直以直言不讳著称 , 他在社交网络上经常会对热门的深度学习研究发表评论 , 也可以直面其他人工智能著名研究者的批评 。

机器学习模型中的偏见可能会使得推理的专业性受到侵害 , 导致大量业务遭受影响却不为人所知 。 我们还没有解决这个问题一劳永逸的方法 。

参考内容:

https://analyticsindiamag.com/yann-lecun-machine-learning-bias-debate/

推荐阅读

- 青年|西安邮电大学与安康汉滨区深度合作,研发适合毛绒玩具全产业链实用技术

- 行业互联网,智慧医疗|商汤科技创“心”升级,探索“联邦学习”入选ECCV

- 技术编程|机器学习又一重要医学应用!培植人造器官

- 大众新闻|海外高知妈妈都头疼的中文学习,LingoAce有什么好办法?

- 中文|海外高知妈妈都头疼的中文学习,LingoAce有什么好办法?

- 科学|亚太卫星深度报告(上):卫星这块蛋糕有多大?

- 公司|中登集团学习群:公司请你来做什么

- 青年|《逻7识智》脑训7:学习

- |麦哥说电商:深度揭秘信息流创意曝光机制

- 中年|机器学习必读TOP 100论文清单:高引用、覆盖面广丨GitHub 21.4k星

![[刘姚尧的文字城堡]1纪录创80后历史,丁俊晖终进斯诺克TOP10!1项排名高居第5](https://imgcdn.toutiaoyule.com/20200410/20200410064922907030a_t.jpeg)