з ”з©¶|дәәзұ»е’ҢжңәеҷЁж„ҹзҹҘжҜ”иҫғдёӯеёёи§Ғзҡ„дёүеӨ§йҷ·йҳұпјҢдҪ дёӯдәҶеҮ жқЎпјҹ( дёү )

ж–Үз« еӣҫзүҮ

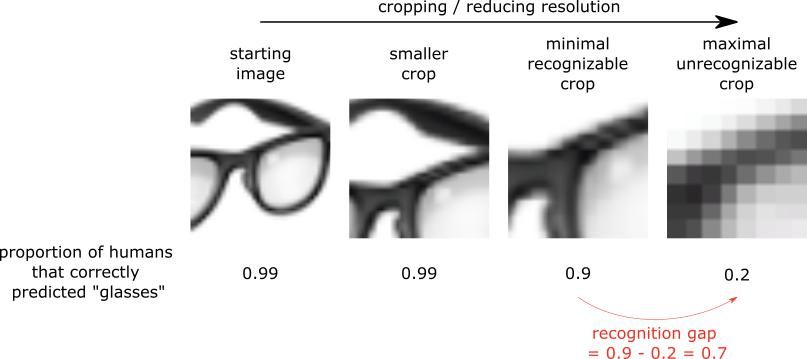

еҪ“иЈҒеүӘжҲ–йҷҚдҪҺеӣҫеғҸеҲҶиҫЁзҺҮж—¶пјҢжҲ‘们жңҖз»Ҳдјҡж— жі•иҜҶеҲ«е…¶дёӯзҡ„зү©дҪ“гҖӮе®һйӘҢиЎЁжҳҺпјҢиҝҷдёӘиҝҮзЁӢдёӯеҸҜиҜҶеҲ«еәҰдјҡжҖҘеү§дёӢйҷҚпјҢдёӢйҷҚзҡ„зЁӢеәҰиў«з§°дёәвҖңеҸҜиҜҶеҲ«е·®вҖқгҖӮиҜ·жіЁж„ҸпјҢжӯӨеӣҫдёӯзҡ„жҜ”дҫӢе’ҢиЈҒеүӘжҳҜдёәдәҶзӨәж„ҸиҖҢзј–еҲ¶зҡ„гҖӮ

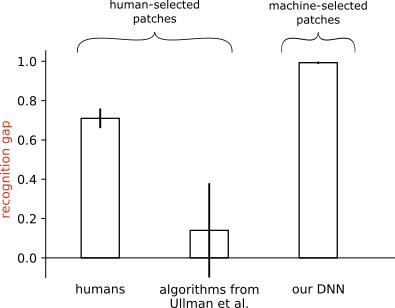

UllmanзӯүдәәжүҫеҮәдәҶдәәзұ»д»ҚиғҪиҫЁи®ӨеҮәзү©дҪ“еӣҫеғҸзҡ„жңҖе°ҸйғЁеҲҶпјҢ他们иҝҳжөӢиҜ•дәҶжңәеҷЁзҡ„и§Ҷи§үз®—жі•жҳҜеҗҰе…·жңүеҗҢж ·жҳҺжҳҫзҡ„е·®и·қгҖӮз»“жһңеҸ‘зҺ°пјҢеңЁжүҖжөӢиҜ•зҡ„жңәеҷЁи§Ҷи§үз®—жі•дёӯпјҢеҸҜиҜҶеҲ«е·®иҰҒе°Ҹеҫ—еӨҡпјҲзӯүдәҺ0.14пјүпјҢ并еҫ—еҮәз»“и®әпјҢжңәеҷЁдёҺдәәзұ»и§Ҷи§үзі»з»ҹзҡ„еҠҹиғҪжңүжүҖдёҚеҗҢпјҲжҜ”иҫғ第дәҢдёӘеӣҫдёӯе·Ұиҫ№зҡ„дёӨдёӘжҹұеҪўпјүгҖӮ

еңЁжҲ‘们зҡ„е·ҘдҪңдёӯпјҢжҲ‘们еңЁдёҖдёӘдёҺUllmanзӯүдәәзҡ„е®һйӘҢйқһеёёзӣёдјјзҡ„е®һйӘҢи®ҫи®ЎдёӯпјҢйҮҚж–°е®Ўи§ҶдәҶеҸҜиҜҶеҲ«е·®пјҢдҪҶдёӨиҖ…д№Ӣй—ҙжңүдёҖдёӘе…ій”®зҡ„еҢәеҲ«пјҡжҲ‘们жҳҜеңЁжңәеҷЁйҖүжӢ©зҡ„еӣҫеқ—иҖҢдёҚжҳҜдәәзұ»йҖүжӢ©зҡ„еӣҫеқ—дёҠжөӢиҜ•жңәеҷЁгҖӮе…·дҪ“ең°иҜҙпјҢжҲ‘们еҲ©з”ЁжңҖе…Ҳиҝӣзҡ„ж·ұеҚ·з§ҜзҘһз»ҸзҪ‘з»ңе®һзҺ°дәҶдёҖз§Қжҗңзҙўз®—жі•пјҢе®ғжЁЎд»ҝдәҶдәәзұ»е®һйӘҢгҖӮиҝҷе°ұзЎ®дҝқдәҶжңәеҷЁеңЁд»–们йҖүжӢ©зҡ„еӣҫеқ—дёҠиў«иҜ„дј°вҖ”вҖ”е°ұеғҸдәәзұ»еңЁд»–们йҖүжӢ©зҡ„еӣҫеқ—дёҠиў«иҜ„дј°дёҖж ·гҖӮ

ж–Үз« еӣҫзүҮ

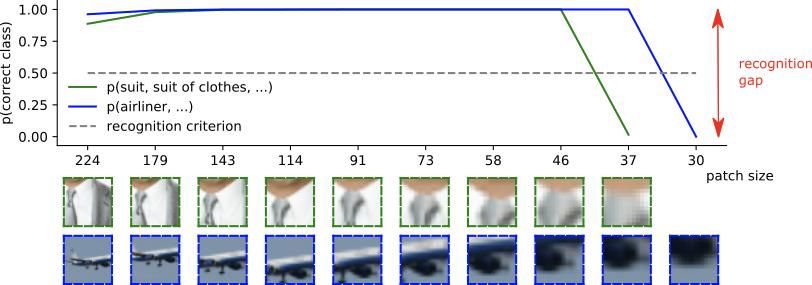

жҲ‘们用DNNе®һзҺ°дәҶдёҖдёӘжЁЎжӢҹдәәзұ»е®һйӘҢзҡ„жҗңзҙўз®—жі•гҖӮжӯЈзЎ®иҜҶеҲ«зҡ„жҰӮзҺҮз»ҳеҲ¶еңЁyиҪҙдёҠпјҢеҜ№еә”дәҺxиҪҙдёҠеҮҸе°‘зҡ„иЈҒеүӘгҖӮдёҺдәәзұ»е®һйӘҢзұ»дјјпјҢеҪ“дёҚиғҪиҫЁеҲ«еҮәзү©дҪ“ж—¶пјҢжӯЈзЎ®иҜҶеҲ«жҰӮзҺҮжҖҘеү§дёӢйҷҚгҖӮжҚўеҸҘиҜқиҜҙпјҢжҲ‘们еҸ‘зҺ°жҲ‘们зҡ„жңәеҷЁз®—жі•д№ҹжңүеҫҲеӨ§зҡ„еҸҜиҜҶеҲ«е·®гҖӮ

жҲ‘们еҸ‘зҺ°пјҢеңЁиҝҷдәӣжқЎд»¶дёӢпјҢжҲ‘们зҡ„зҘһз»ҸзҪ‘з»ңзЎ®е®һеңЁжңҖе°ҸеҸҜиҜҶеҲ«иЈҒеүӘе’ҢжңҖеӨ§дёҚеҸҜиҜҶеҲ«иЈҒеүӘд№Ӣй—ҙе…·жңүеҗҢж ·еӨ§зҡ„еҸҜиҜҶеҲ«е·®пјҢжӯЈеҰӮUllmanзӯүдәәй’ҲеҜ№дәәзұ»зҡ„е®һйӘҢз»“жһңдёҖж ·гҖӮ

ж–Үз« еӣҫзүҮ

д»Һе·ҰеҲ°еҸізҡ„еҸҜиҜҶеҲ«е·®пјҡUllmanзӯүдәә2016е№ҙз”Ёдәәзұ»йҖүжӢ©зҡ„еӣҫеқ—еҜ№дәәзұ»е’ҢжңәеҷЁз®—жі•иҝӣиЎҢжөӢиҜ•пјӣжҲ‘们зҡ„DNNеңЁжңәеҷЁйҖүжӢ©зҡ„еӣҫеқ—дёҠиҝӣиЎҢжөӢиҜ•гҖӮеҪ“з”ЁеңЁжңәеҷЁйҖүжӢ©зҡ„еӣҫеқ—дёҠиҝӣиЎҢжөӢиҜ•ж—¶пјҢжҲ‘们зҡ„DNNжңүдёҖдёӘеҫҲеӨ§зҡ„еҸҜиҜҶеҲ«е·®пјҢиҝҷдёҺUllmanзӯүдәәеңЁ2016е№ҙз”Ёдәәзұ»йҖүжӢ©зҡ„еӣҫеқ—жөӢиҜ•жңәеҷЁз®—жі•жүҖеҫ—еҲ°зҡ„з»“жһңдёҚеҗҢгҖӮ

иҝҷдёӘжЎҲдҫӢз ”з©¶иҜҙжҳҺпјҢйҖӮеҪ“и°ғж•ҙдәәзұ»е’ҢжңәеҷЁзҡ„жөӢиҜ•жқЎд»¶еҜ№дәҺжҜ”иҫғдёӨдёӘзі»з»ҹд№Ӣй—ҙзҡ„зҺ°иұЎжҳҜйқһеёёйҮҚиҰҒзҡ„гҖӮ

жҖ»з»“

дёҠиҝ°дёүдёӘжЎҲдҫӢз ”з©¶зӘҒеҮәдәҶеңЁжҜ”иҫғдәәе’ҢжңәеҷЁж—¶йқўдёҙзҡ„еҮ еӨ§йҡҫзӮ№гҖӮжң¬ж–Үзү№еҲ«ејәи°ғдәҶиҝҷеҮ зӮ№пјҡзЎ®и®ӨеҒҸе·®дјҡеҜјиҮҙеҜ№з»“жһңзҡ„й”ҷиҜҜи§ЈйҮҠпјҢд»Һзү№е®ҡзҡ„дҪ“зі»з»“жһ„е’Ңи®ӯз»ғиҝҮзЁӢдёӯеҪ’зәіз»“и®әжҳҜеҫҲеӣ°йҡҫзҡ„пјҢжқЎд»¶дёҚзӣёзӯүзҡ„жөӢиҜ•иҝҮзЁӢдјҡеҜјиҮҙй”ҷиҜҜзҡ„еҶізӯ–иЎҢдёәгҖӮ

з»јдёҠжүҖиҝ°пјҢеңЁиҝӣиЎҢдёҘи°Ёзҡ„дәәжңәжҜ”иҫғж—¶пјҢжҲ‘们еҝ…йЎ»дҝқжҢҒи°Ёж…ҺпјҢ并е°ҪйҮҸеҮҸе°‘жҲ‘д»¬д№ д»Ҙдёәеёёзҡ„дәәзұ»еҒҸи§ҒгҖӮеҸӘжңүиҝҷж ·пјҢдәәе·ҘжҷәиғҪе’Ңдәәзұ»д№Ӣй—ҙзҡ„жҜ”иҫғз ”з©¶жүҚиғҪеҜҢжңүжҲҗж•ҲгҖӮ

via https://thegradient.pub/challenges-of-comparing-human-and-machine-perception/

жӢӣ иҒҳ

AI 科жҠҖиҜ„и®әеёҢжңӣиғҪеӨҹжӢӣиҒҳ 科жҠҖзј–иҫ‘/йҮҮи®ҝдәәе‘ҳ

еҠһе…¬ең°зӮ№пјҡеҢ—дә¬/ж·ұеңі

иҒҢеҠЎпјҡд»Ҙи·ҹиёӘеӯҰжңҜзғӯзӮ№гҖҒдәәзү©дё“и®ҝдёәдё»

е·ҘдҪңеҶ…е®№пјҡ

1гҖҒе…іжіЁеӯҰжңҜйўҶеҹҹзғӯзӮ№дәӢ件пјҢ并еҸҠж—¶и·ҹиёӘжҠҘйҒ“пјӣ

2гҖҒйҮҮи®ҝдәәе·ҘжҷәиғҪйўҶеҹҹеӯҰиҖ…жҲ–з ”еҸ‘дәәе‘ҳпјӣ

3гҖҒеҸӮеҠ еҗ„з§Қдәәе·ҘжҷәиғҪеӯҰжңҜдјҡи®®пјҢ并еҒҡдјҡи®®еҶ…е®№жҠҘйҒ“гҖӮ

иҰҒжұӮпјҡ

1гҖҒзғӯзҲұдәәе·ҘжҷәиғҪеӯҰжңҜз ”з©¶еҶ…е®№пјҢж“…й•ҝдёҺеӯҰиҖ…жҲ–дјҒдёҡе·ҘзЁӢдәәе‘ҳжү“дәӨйҒ“пјӣ

2гҖҒжңүдёҖе®ҡзҡ„зҗҶе·Ҙ科иғҢжҷҜпјҢеҜ№дәәе·ҘжҷәиғҪжҠҖжңҜжңүжүҖдәҶи§ЈиҖ…жӣҙдҪіпјӣ

3гҖҒиӢұиҜӯиғҪеҠӣејәпјҲе·ҘдҪңеҶ…е®№ж¶үеҸҠеӨ§йҮҸиӢұж–Үиө„ж–ҷпјүпјӣ

гҖҗ з ”з©¶|дәәзұ»е’ҢжңәеҷЁж„ҹзҹҘжҜ”иҫғдёӯеёёи§Ғзҡ„дёүеӨ§йҷ·йҳұпјҢдҪ дёӯдәҶеҮ жқЎпјҹгҖ‘4гҖҒеӯҰд№ иғҪеҠӣејәпјҢеҜ№дәәе·ҘжҷәиғҪеүҚжІҝжҠҖжңҜжңүдёҖе®ҡзҡ„дәҶи§ЈпјҢ并иғҪеӨҹйҖҗжёҗеҪўжҲҗиҮӘе·ұзҡ„и§ӮзӮ№гҖӮ

жҺЁиҚҗйҳ…иҜ»

- иҝӣиЎҢ|вҖңдә’иҒ”зҪ‘ж—¶д»Ј+вҖқиғҢжҷҜдёӢе“ҒзүҢз«ҘиЈ…жҠҳжүЈеә—зҡ„еҸ‘еұ•еҜ№зӯ–з ”з©¶

- |гҖҠжҲ‘зҡ„еҘіеҸӢжҳҜжңәеҷЁдәәгҖӢйҰ–жӣқиҠұзө®пјҢиҫӣиҠ·и•ҫеҢ…иҙқе°”жҗһжҖӘ

- жһ—еҝ—йў–|еҪ“жҳҺжҳҹйғҪе«ҢжқҘй’ұж…ўпјҹжһ—еҝ—йў–з ”з©¶иҮӘе·ұпјҢеј еәӯеӨ«еҰҮеҚ–йқўиҶң

- з–ҜзӢӮжҠ№й»‘пјҒдёӨеҗҚдёӯеӣҪзұҚй«ҳж Ўз ”з©¶дәәе‘ҳеңЁзҫҺиў«жҚ•пјҢзҫҺеҸёжі•йғЁе®Јз§°е…¶вҖңз ҙеқҸиҜҒжҚ®вҖқвҖңзӘғеҸ–жңәеҜҶвҖқ

- жңәеҷЁдәә|AIи®ӯз»ғеёҲи®©жңәеҷЁдәәжӣҙиҒӘжҳҺ

- жҫіеӨ§еҲ©дәҡжҲҳз•Ҙж”ҝзӯ–з ”з©¶жүҖпјҡиҮӯеҗҚжҳӯи‘—зҡ„вҖңзүөзәҝжңЁеҒ¶вҖқпјҒ

- иө·еә•жҫіеӨ§еҲ©дәҡжҲҳз•Ҙж”ҝзӯ–з ”з©¶жүҖпјҡиҮӯеҗҚжҳӯи‘—зҡ„вҖңзүөзәҝжңЁеҒ¶вҖқпјҒ

- гҖҢж–°жөӘ科жҠҖгҖҚиҜҰ解马ж–Ҝе…ӢNeuralinkеӨ–科жүӢжңҜжңәеҷЁдәәж–°жөӘ科жҠҖ2020-08-29 08:30:180йҳ…

- IT|з ”з©¶еҸ‘зҺ°ж— зҘһи®әиҖ…еңЁзқЎзң иҙЁйҮҸж–№йқўиғңиҝҮе®—ж•ҷж•ҷеҫ’

- и®әж–Ү|дёӯ科еӨ§еӯҰжңҜ委е‘ҳдјҡеӣһеә”вҖңжғ…дҫЈйҖҒзӨјз ”究вҖқеҚҡеЈ«и®әж–ҮпјҡдёҚиҜ„д»·еҘҪеқҸ