【 GAN|这个AI“大师级”简笔画水平,惊艳到了网友:竟然不用GAN】金磊 发自 凹非寺

量子位 报道 | 公众号 QbitAI

AI画的简笔画能到什么水平?

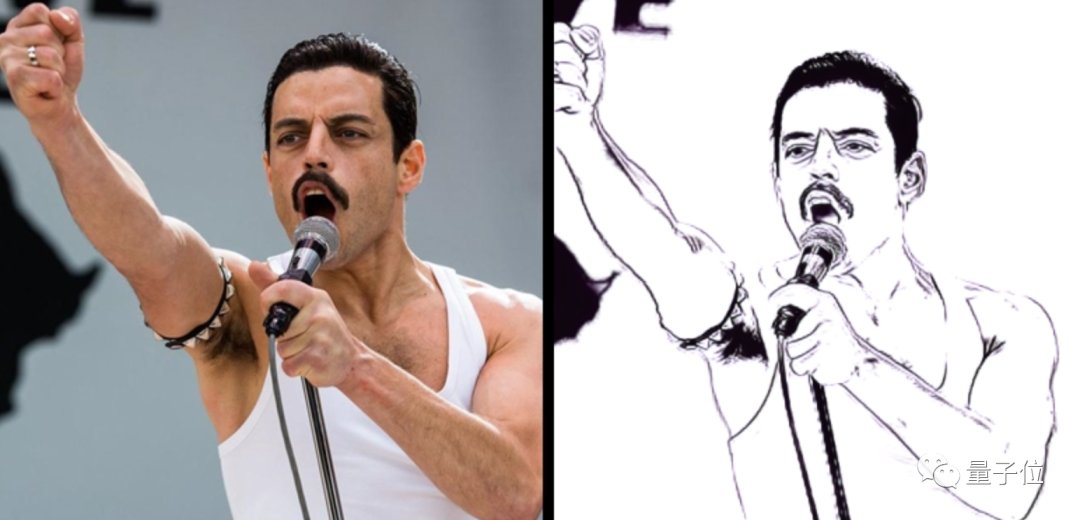

给一张美国演员Rami Malek的照片,效果是这样的。

文章插图

是不是和原图很逼近了?

再来看下输入《老友记》合影的效果。

文章插图

虽然人物众多,但出来的简笔画效果,依旧还是能分清剧中的人物。

如果毛发特别浓密的人物照,AI还能hold得住吗?

文章插图

小姐姐“爆炸头”的边缘毛发,也算得上是完美还原了。

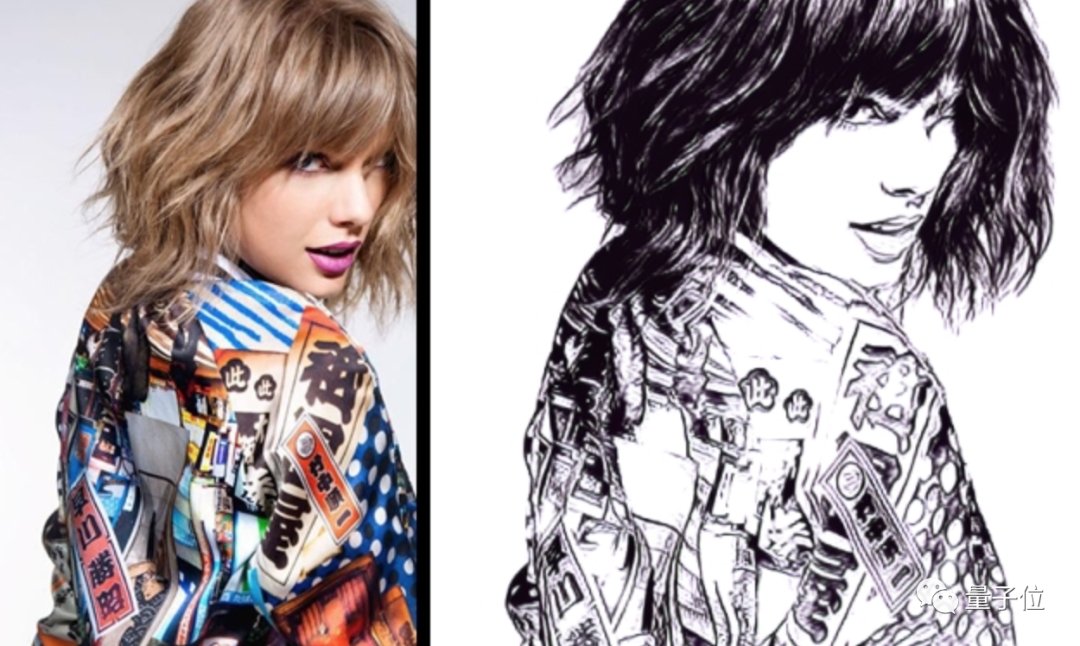

再近距离一些的呢?来看“霉霉”(Taylor Swift)照片的效果。

文章插图

可以说是相当的细节了,把发丝的层次感、光感,以及衣物的褶皱,都发挥的“淋漓尽致”。

……

这些就是出自一个叫ArtLine的AI的作品。

而且它在Reddit非常火爆,已经达到了1100+的热度。

文章插图

如此惟妙惟肖的效果,你是不是认为又是GAN的功劳?

错!

ArtLine完全没有用到GAN:

文章插图

也正因如此,ArtLine的效果真真儿的惊艳到了网友。

那么,它是如何做到的呢?

ArtLine背后的三大“法宝”

ArtLine的作者十分爽快地分享了其背后的三大技术:

Self-Attention

Progressive Resizing

Generator Loss

接下来,一起逐一看下各个技术背后的细节内容。

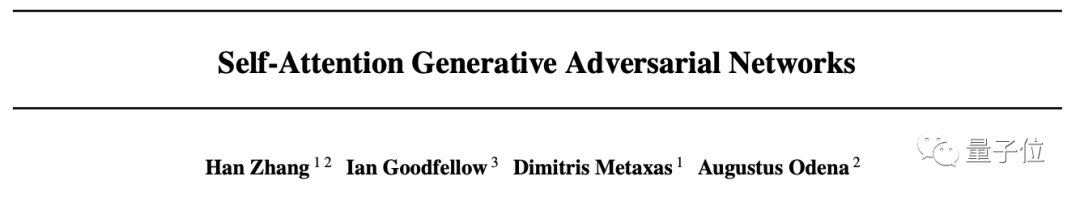

Self-Attention部分引用的技术,出自两年前GAN之父lan Goodfellow等人提出的研究。

文章插图

等等,刚才不是还说“没用到GAN”吗?

作者对此的解释是:

并没有起到太大作用。

这项研究主要是在GAN生成中加入了注意力机制,同时将SNgan的思想引入到生成器当中。

所要解决的是传统GAN自身存在的一些问题,例如:

使用小的卷积核很难发现图像中的依赖关系

使用大的卷积核就会丧失卷积网络参数与计算的效率

研究中核心的自注意力机制如下图所示。

文章插图

其中,f(x),g(x)和h(x)都是普通的1x1卷积,差别只在于输出通道大小不同。

而后,将f(x)的输出转置,并和g(x)的输出相乘,再经过softmax归一化,得到一个Attention Map。

得到Attention Map之后,和h(x)逐像素点相乘,得到自适应的注意力feature maps。

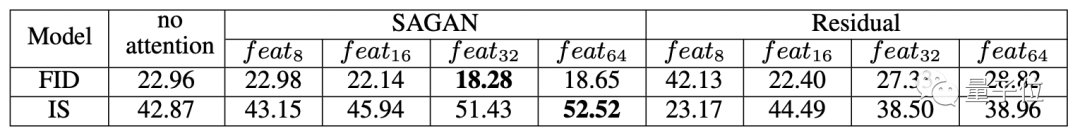

文章插图

从结果上来看,引入自注意力机制的效果,确实在FID和IS两个性能指标下,得到了较好的效果。

ArtLine涉及到的第二个技术灵感,来自英伟达在2018年的一项研究。

文章插图

这项研究主要提出了一种新的训练对抗神经网络的方法。

核心思想是逐步训练生成器和判别器:从低分辨率开始,随着训练进程推进,逐步增加新的层来提炼细节。

文章插图

这种方法不仅加快了训练速度并且更加稳定,可以产生高质量的图像。

推荐阅读

- 明朝末年资本主义经济和思想发展到了什么程度,当时的统治阶级是否已经意识到了这个问题?

- 戴宗跑得快,全凭甲马带!那么这个宝贝到底是怎能来的?

- 罗素:对平庸的崇拜是我们这个时代最大的恶之一

- 这个猪八戒是史上颜值最高的,竟然那么的帅,你绝对没见过!

- 李进朗诵《这个人》

- 猪八戒俗名为啥叫做猪刚鬣这个名字是谁给他起的

- 来这个博物馆,看海里的百合花

- 这个女人不一般:离婚后获得新生,变身银行副总裁

- 观点太反人性,这个组织,一直被官府严打,但它熬死了5个朝代

- 宋江为什么要招安,而不选择自己当皇帝?看完这个你就知道了!